Principales riesgos éticos de la inteligencia artificial y cómo afectan a la sociedad

La inteligencia artificial se ha incorporado de forma progresiva a la vida cotidiana y al ámbito profesional, impulsando la innovación en múltiples sectores como la salud, hasta convertirse en una herramienta habitual para la búsqueda de información, la resolución de consultas y el apoyo en múltiples tareas.

No obstante, cada interacción con estos sistemas puede implicar la cesión de una cantidad considerable de datos que, de forma directa o indirecta, contribuyen a su entrenamiento, ajuste y perfeccionamiento. Este fenómeno sitúa a la IA en el centro de un debate que trasciende lo tecnológico y alcanza dimensiones éticas, jurídicas y sociales.

En este sentido, la inteligencia artificial no puede entenderse como una tecnología neutral, ya que su capacidad para procesar información, establecer patrones y automatizar decisiones puede generar tanto beneficios como riesgos.

Su aplicación en ámbitos como la personalización de contenidos, la selección de personal o la concesión de créditos evidencia la necesidad de examinar críticamente sus efectos sobre los derechos fundamentales y la igualdad.

Por ello, abordar los riesgos éticos de la IA no implica cuestionar su utilidad, sino analizar los principios, límites y mecanismos de control que deben orientar su desarrollo y uso para garantizar una implementación responsable.

Qué es la ética en la inteligencia artificial (IA)

La ética en la inteligencia artificial (IA) es el conjunto de principios, valores y normas que orientan el diseño, desarrollo, implementación y uso de estos sistemas, con el fin de garantizar que esta tecnología se utilice de manera segura, responsable y beneficiosa para la sociedad, evitando la vulneración de derechos fundamentales y la reproducción de sesgos o discriminaciones, especialmente hacia grupos minoritarios.

Máster Universitario en Derecho y Ética de la Inteligencia Artificial

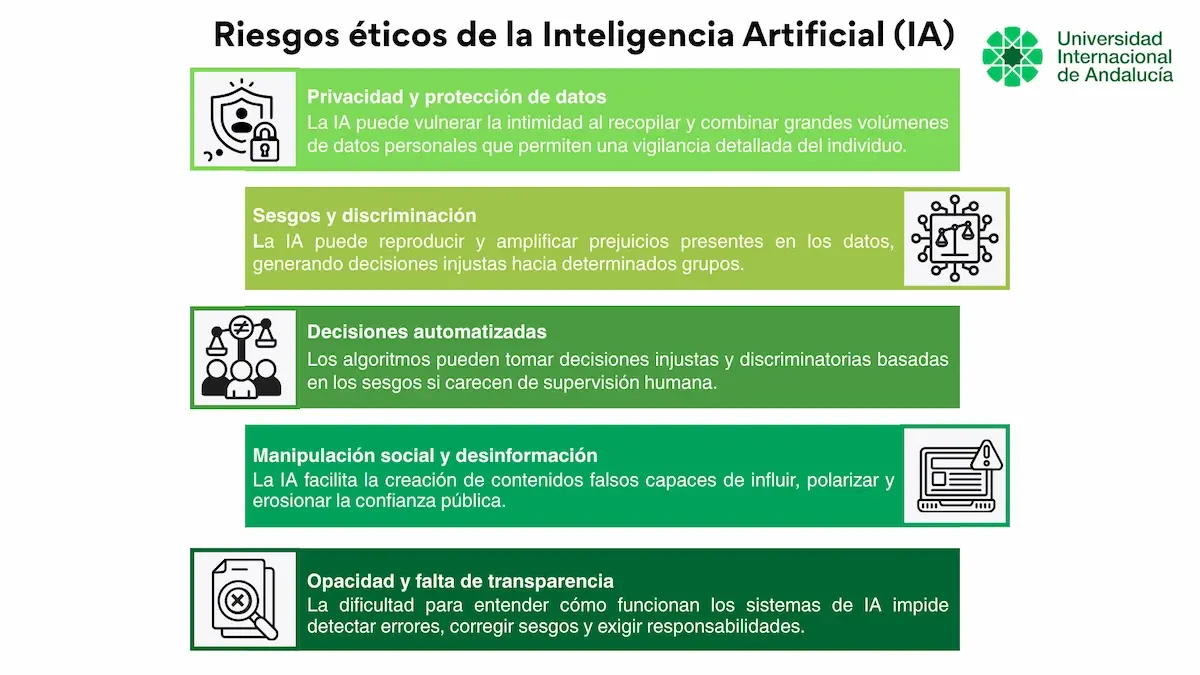

Principales riesgos éticos de la Inteligencia artificial (IA)

La inteligencia artificial plantea una serie de riesgos éticos que van más allá de su dimensión tecnológica, al incidir directamente en derechos, libertades e intereses sociales.

A continuación, se presentan los principales riesgos éticos vinculados a su desarrollo y utilización.

Privacidad y protección de datos

Uno de los primeros riesgos éticos de la inteligencia artificial aparece en la recopilación y tratamiento masivo de datos. Estos sistemas necesitan grandes cantidades de información para entrenarse, aprender patrones y generar predicciones, pero ese proceso puede entrar en conflicto con la intimidad y la vida privada de las personas.

El problema no se limita a la cantidad de datos recogidos, sino también a su origen, legitimidad y uso posterior. Cuando la IA combina información personal, hábitos digitales, imágenes, ubicación o historial de comportamiento, puede construir una visión muy detallada del individuo, incluso más allá de lo que este ha revelado de forma consciente.

De este modo, tecnologías como el reconocimiento facial, el rastreo online o la creación de perfiles amplían el riesgo de vigilancia, monitorización constante y pérdida de control sobre la propia información.

Además, con el auge de las redes sociales y la implementación de la inteligencia artificial para recopilar datos en estas plataformas, la frontera de la privacidad puede desaparecer. Estos sistemas capturan la huella digital de los usuarios para inferir rasgos íntimos —como ideologías o estados de ánimo— que no ha revelado conscientemente.

Sesgos y discriminación

A partir de los datos recopilados, la inteligencia artificial puede clasificar, segmentar y perfilar a las personas, especialmente cuando emplea técnicas de machine learning para detectar patrones y generar predicciones.. Aquí surge un segundo gran riesgo ético: que esos perfiles reproduzcan sesgos presentes en los datos o en el diseño del sistema.

La IA puede aprender patrones discriminatorios si ha sido entrenada con información incompleta, poco representativa o marcada por desigualdades previas. En ese caso, el sistema no solo refleja un sesgo existente, sino que puede reforzarlo y darle apariencia de objetividad técnica.

Esto resulta especialmente grave cuando perjudica a determinados grupos por razón de sexo, edad, origen, discapacidad o situación socioeconómica. Además, la creación de perfiles puede encasillar a las personas en categorías rígidas, limitar sus opciones y perpetuar estigmas sociales.

Decisiones automatizadas

El siguiente nivel de riesgo aparece cuando esos perfiles y predicciones se utilizan para tomar decisiones automatizadas en ámbitos sensibles. Es decir, la discriminación ya no se queda en una clasificación interna del sistema, sino que se traduce en consecuencias reales para las personas.

Esto puede ocurrir en contextos como la concesión de préstamos, la selección de personal, la contratación de seguros, la asignación de recursos públicos o la priorización de determinados usuarios frente a otros.

El problema ético surge cuando la decisión depende en exceso del algoritmo y la intervención humana es inexistente o meramente formal. En estos casos, una persona puede verse perjudicada por una lógica automatizada que no comprende, no puede cuestionar de forma efectiva y que, además, puede estar basada en inferencias sesgadas. Por eso, las decisiones automatizadas representan uno de los puntos más delicados en el debate sobre la ética de la IA.

Manipulación social y desinformación

Más allá del impacto individual, la inteligencia artificial también puede afectar al plano colectivo mediante la manipulación de la información. Herramientas capaces de generar textos, imágenes, audios o vídeos falsos pero verosímiles facilitan la difusión de contenido engañoso a gran escala.

Este riesgo se aprecia de forma clara en los deepfakes, en las campañas automatizadas de desinformación y en la creación de mensajes diseñados para polarizar, influir emocionalmente o condicionar la opinión pública.

Sus efectos pueden ir desde el fraude económico o el daño reputacional hasta la alteración del debate democrático. En este caso, el problema ético no radica solo en que la información sea falsa, sino en su capacidad para erosionar la confianza social y dificultar la distinción entre lo auténtico y lo manipulado.

Opacidad y falta de transparencia

A todo lo anterior se suma un riesgo transversal: la opacidad de los sistemas de inteligencia artificial. En muchas ocasiones, ni los usuarios ni las personas afectadas saben con claridad cómo funciona el sistema, qué variables ha tenido en cuenta o por qué ha llegado a una determinada conclusión.

Esta falta de transparencia dificulta detectar errores, corregir sesgos, exigir responsabilidades o impugnar decisiones injustas. Por eso, la opacidad agrava todos los riesgos anteriores: si no se entiende cómo se recopilan los datos, cómo se crean los perfiles o cómo se toman las decisiones, resulta mucho más difícil proteger derechos y aplicar controles efectivos. En ámbitos especialmente sensibles, como la salud, la justicia o el empleo, esta falta de explicabilidad puede tener consecuencias especialmente graves.

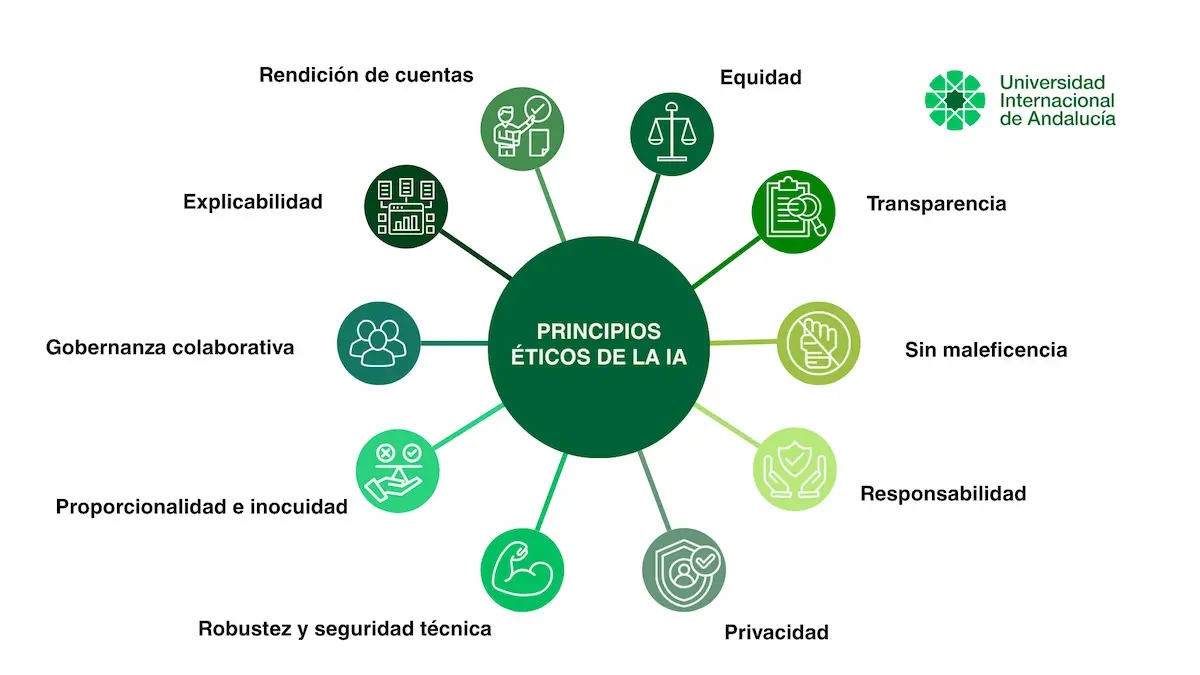

Principios y directrices éticas de la inteligencia artificial para prevenir sus riesgos

Frente a los riesgos éticos que plantea la inteligencia artificial, los principios y directrices éticas constituyen el marco que debe orientar su diseño, desarrollo y aplicación.

Su función es ofrecer criterios para prevenir daños, corregir desviaciones y garantizar que el uso de esta tecnología sea compatible con los derechos fundamentales, la igualdad, la seguridad y el interés general.

A continuación, se enumeran los principales principios éticos que deben guiar el desarrollo y la utilización de la IA como base para un uso responsable y socialmente seguro.

Equidad

La equidad exige evitar sesgos y discriminación en los datos, en los modelos y en los algoritmos para garantizar resultados justos. Un sistema de IA no debe perjudicar a una persona por su sexo, edad, origen, discapacidad u otra condición personal o social.

Transparencia

La transparencia implica diseñar sistemas cuyo funcionamiento pueda comprenderse, al menos en un nivel suficiente para conocer cómo se adoptan las decisiones y bajo qué criterios operan.

Para ello, debe garantizarse la trazabilidad de los sistemas. Es decir, registrar y documentar tanto las decisiones tomadas como el proceso completo que ha llevado a ellas. Además, resulta esencial comunicar de forma clara las capacidades, límites y riesgos del sistema a las distintas partes interesadas.

Sin maleficencia

El principio de no maleficencia parte de una idea básica: la IA no debe utilizarse para causar daño. Esto obliga a identificar, evaluar y reducir los riesgos potenciales que pueden derivarse de su uso, especialmente cuando afecta a la seguridad, la reputación, la igualdad, la autonomía de las personas o en ámbitos tan importantes como la salud.

Aplicado a la práctica, este principio exige anticipar efectos adversos, prevenir usos abusivos y evitar que la automatización provoque perjuicios injustificados, aunque estos no hayan sido intencionados por sus desarrolladores.

Responsabilidad

La responsabilidad implica que tanto los desarrolladores como las organizaciones que implementan inteligencia artificial deben responder por sus decisiones, por el modo en que usan esta tecnología y por las consecuencias que genera.

No basta con que una decisión la tome un algoritmo. Siempre debe existir una estructura clara de responsabilidades que permita determinar quién supervisa el sistema, quién valida sus resultados y quién asume las consecuencias en caso de error, daño o discriminación.

Privacidad

La privacidad exige proteger los datos personales y garantizar que las personas mantengan el control sobre el uso de su información. Este principio debe respetarse en todas las fases del ciclo de vida del sistema, desde la recogida de datos hasta su almacenamiento, análisis y posible reutilización.

La cuestión es especialmente sensible porque los registros digitales del comportamiento humano permiten inferir no solo preferencias o hábitos de consumo, sino también información especialmente delicada, como ideología, orientación sexual, religión o estado de salud. Por ello, es imprescindible asegurar que esos datos no se utilicen para perjudicar, manipular o discriminar a los usuarios.

Robustez y seguridad técnica

La IA debe ser técnicamente robusta, fiable y resiliente. Esto significa que sus algoritmos deben resistir errores, incoherencias, accesos no autorizados, ciberataques o intentos de manipulación de datos y modelos.

Para ello, los sistemas inteligentes deben contar con planes de contingencia y niveles adecuados de seguridad.

Proporcionalidad e inocuidad

El principio de proporcionalidad exige que la IA se utilice para fines legítimos y que los medios empleados no resulten excesivos respecto al objetivo perseguido. No todo lo técnicamente posible es éticamente aceptable.

Esto es especialmente importante en ámbitos como la videovigilancia, el reconocimiento facial, la monitorización de empleados o la elaboración masiva de perfiles. El uso de la IA debe ser adecuado, necesario y proporcionado, evitando aplicaciones invasivas o desmedidas.

Gobernanza colaborativa

La supervisión de la inteligencia artificial no puede recaer únicamente en empresas tecnológicas o desarrolladores. Debe articularse mediante una gobernanza colaborativa que involucre a gobiernos, organizaciones, sociedad civil, expertos y usuarios afectados.

En este marco, la supervisión humana resulta imprescindible. Puede aplicarse mediante fórmulas como la participación humana en el proceso de decisión, la supervisión humana del sistema o el control humano sobre su funcionamiento. La automatización no debe suprimir la capacidad de intervención de las personas cuando están en juego derechos o intereses relevantes.

Explicabilidad

La explicabilidad va un paso más allá de la transparencia. No solo implica que el sistema sea trazable, sino que las personas afectadas puedan comprender, en términos razonables, por qué se ha tomado una determinada decisión automatizada.

Este principio es fundamental cuando la IA interviene en procesos sensibles como la concesión de ayudas, la selección de personal, el diagnóstico médico o la evaluación del riesgo. Sin explicación suficiente, resulta muy difícil impugnar una decisión o detectar un posible abuso.

Rendición de cuentas

La rendición de cuentas exige que los sistemas de IA puedan ser auditados y evaluados, tanto por órganos internos como externos. Los posibles impactos negativos deben identificarse, documentarse, revisarse y reducirse al mínimo.

Además, cuando se produzcan efectos adversos o injustos, deben existir mecanismos accesibles para reclamar, revisar la decisión y obtener una reparación adecuada. Sin auditoría, sin documentación y sin remedios efectivos, la ética de la IA queda en una mera declaración de intenciones.

Conclusión

En este contexto, resulta evidente que el desarrollo de una inteligencia artificial segura y socialmente responsable no depende únicamente del avance tecnológico, sino también en la existencia de profesionales capaces de comprender sus implicaciones jurídicas, éticas y regulatorias.

Ante este escenario, la formación especializada se convierte en un elemento clave para garantizar un uso seguro, justo y responsable de la inteligencia artificial. Programas como el Máster Universitario en Derecho y Ética de la Inteligencia Artificial de la Universidad Internacional de Andalucía (UNIA) ofrecen una formación oficial y especializada, con un enfoque centrado en la gobernanza, los derechos fundamentales, la regulación europea, la protección de datos y los principales retos ético-jurídicos de la IA, con el objetivo de formar profesionales capaces de afrontar con rigor los desafíos que plantea esta tecnología y de contribuir a su desarrollo al servicio de la sociedad.

Fuentes

Gándara, T. D. J. C. (2026). Entre la Innovación y el Riesgo: Los Retos Éticos de la Inteligencia Artificial. Ciencia y Reflexión, 5(1), 137-156.

Porcelli, A. M. (2020). Inteligencia Artificial y la Robótica: sus dilemas sociales, éticos y jurídicos. Derecho Global Estudios Sobre Derecho y Justicia, 6(16), 49-105. https://doi.org/10.32870/dgedj.v6i16.286

Pérez-Ugena, María. 2024. «La Inteligencia Artificial: Definición, regulación Y Riesgos Para Los Derechos Fundamentales». Estudios De Deusto 72 (1), 307-37. https://doi.org/10.18543/ed.3108

Alvarado, H. P. L., & Villavicencio, O. E. C. (2024). Regulación del manejo de la inteligencia artificial, consecuencias y daños a la sociedad por su mal uso. Ciencia Latina Revista Científica Multidisciplinar, 8(1), 1966-1978.

Mehrabi, N., Morstatter, F., Saxena, N., Lerman, K., & Galstyan, A. (2021). A survey on bias and fairness in machine learning. ACM computing surveys (CSUR), 54(6), 1-35.

Martín Jiménez, F. J. (2023). Inteligencia artificial y ética: hacia una aplicación de los principios éticos en el ámbito de la UE. Cuadernos Europeos de Deusto, 68, 89-115. https://doi.org/10.18543/ced.2699

González Arencibia, M., y Martínez Cardero, D. (2020). Dilemas éticos en el escenario de la inteligencia artificial. Economía y Sociedad, 25(57). https://doi.org/10.15359/eys.25-57.5